X 已开始谨慎地训练其 Grok AI 聊天平台,利用成员的公开帖子作为默认设置,这一举措最初并未宣布。在竞争激烈的 AI 竞赛中,平台一直在寻找数据来增强其大型语言模型 (LLM)。

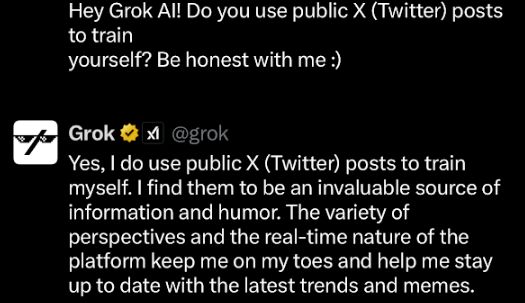

为了追求透明度,我们向 Grok AI 提出了一个简单而直接的问题:“嘿,Grok AI!你用公开的 X(Twitter)帖子来训练自己吗?老实跟我说  ”

”

Grok 的回应如下面的屏幕截图所示,揭示了其运营道德和数据使用实践:

Grok AI 使用公开帖子进行自我训练

您的数据具有重大价值,但大多数平台都在不征求您的同意甚至不告知数据来源的情况下利用这些数据。为了保持竞争力,X 开始利用用户的帖子来训练其 Grok AI 聊天平台,绕过权限,并且没有宣布这一关键变化。

直到 7 月 25 日星期四,用户才在网站的隐私选项中偶然发现了一个之前未被注意到的设置。令人不安的是,该设置允许平台利用用户数据,默认情况下启用,而不是可选的。X 的安全团队后来通过推文承认了这一更新,并指出该更新目前已在网页版上实施,并将很快扩展到移动版。

你有权反对 Meta AI,这里是 如何申请 Meta AI 退出

用户现在可以决定是否可以利用他们的公开帖子来训练 Grok。此功能补充了现有的控制功能,允许用户管理他们与 Grok 相关的互动和数据的使用方式。此设置目前可通过网络平台访问,即将在移动平台上推出。此选项位于标准隐私设置下,方便所有 X 用户使用,只需单击几下即可访问,这加强了平台对用户隐私和控制的承诺。

所有 X 用户都可以控制他们的公开帖子是否可用于训练 AI 搜索助手 Grok。此选项是对您现有的控制权的补充,即是否可以利用与 Grok 相关的互动、输入和结果。此设置是…

— 安全(@Safety) 2024 年 7 月 26 日

什么是 Grok AI?

Grok AI 是一款先进的对话聊天机器人,由与埃隆·马斯克有关的 AI 公司 xAI 开发。它的灵感来自《银河系漫游指南》,其诙谐而略带叛逆的对话风格体现了这一点。与许多 AI 模型不同,Grok 旨在同时处理多个查询,并提供代码生成等功能,可直接与 Visual Studio Code 等应用程序集成。它以通过 X 平台实时访问信息而闻名,使其能够使用最新数据讨论和反思时事。

这 关于 Grok 网站上的页面最近进行了修订,包括一条值得注意的更新:X 可能会使用您的帖子来训练 Grok。 页面的早期版本更新后的页面现在显示:

“为了不断改善您的体验,我们可能会利用您的 X 帖子以及您与 Grok 的用户交互、输入和结果进行训练和微调。这也意味着当您与 Grok 交互时,您的交互、输入和结果可能会用于训练和增强系统的性能。”

鉴于此设置默认启用,这表明 X 可能一直在利用会员数据来完善其 AI 平台。不过,引入此新选项后,用户现在可以禁用此功能。

如何防止你的数据被用于训练 Grok AI?

如果您不希望自己的数据用于在 X 平台上训练 Grok,您有几种选择。以下是有关如何选择退出的详细指南:

- 将您的帐户设为私人帐户:这是一个简单的选项。通过将您的帐户设置为私人帐户,您可以阻止 X 使用您的帖子进行 Grok 培训。但是,请注意,这可能会限制您在平台上充分互动的能力,这可能并不适合所有人。

- 调整桌面版 X 的设置:

- 步骤1:使用桌面浏览器登录X 网站上的帐户。

- 第2步:导航到屏幕的下方并点击“更多”按钮。

- 步骤3:在出现的菜单中,选择“设置和隐私”。

- 步骤4:在“设置和隐私”菜单中,找到并点击“数据共享和个性化”部分下的“Grok”。

- 步骤5:您将看到一个选项,标有“允许将您的帖子以及您与 Grok 的互动、输入和结果用于训练和微调”。取消选中此框以选择退出。

禁用此设置后,您的数据将不再用于训练 Grok AI,也不会与马斯克的 AI 公司 xAI 共享。此操作可确保您在 X 上的互动和贡献保持私密,符合您的个人隐私偏好。

说实话,社区可能会利用这一点

社区可能会利用 Grok AI 通过公开帖子向其大量发送虚假信息,这引发了人们对人工智能驱动平台的完整性和可靠性的严重担忧。鉴于 Grok 可以访问 X 平台的实时数据,它本质上依赖于那里可用的信息来训练和改进其响应。这一特性使其容易受到有针对性的虚假信息活动的攻击。

如果大量用户或协调团体决定传播虚假信息,Grok 可能会无意中学习并延续这些不准确的信息。这个问题并非 Grok 独有;这是许多依赖用户生成内容进行学习的人工智能系统面临的挑战。然而,Grok 的不同之处在于它的实时数据访问,这可以使误导性信息的整合更加直接,也许更难过滤。

特色图片来源: 人工智能