根据一个 英国广播公司 报道称,苹果新发布的人工智能平台Apple Intelligence因错误地宣布谋杀嫌疑人Luigi Mangione的死亡而面临强烈反对。上周通过 iPhone 发送的通知总结了 英国广播公司 报道不正确,导致用户和媒体机构的批评。这一事件对人工智能生成信息的可靠性和准确性提出了重大质疑。

苹果的人工智能工具误报了谋杀嫌疑人的死亡通知

苹果已将 Apple Intelligence 集成到其操作系统中,包括 iOS 18 和 macOS Sequoia。该平台的功能之一是提供专为写作和图像创作而设计的生成式人工智能工具。此外,它还提供了对通知进行分类和汇总的功能,旨在减少用户全天的干扰。然而,最近的虚假通知凸显了这一新功能潜在的不准确和缺陷,让用户感到困惑并担心共享信息的完整性。

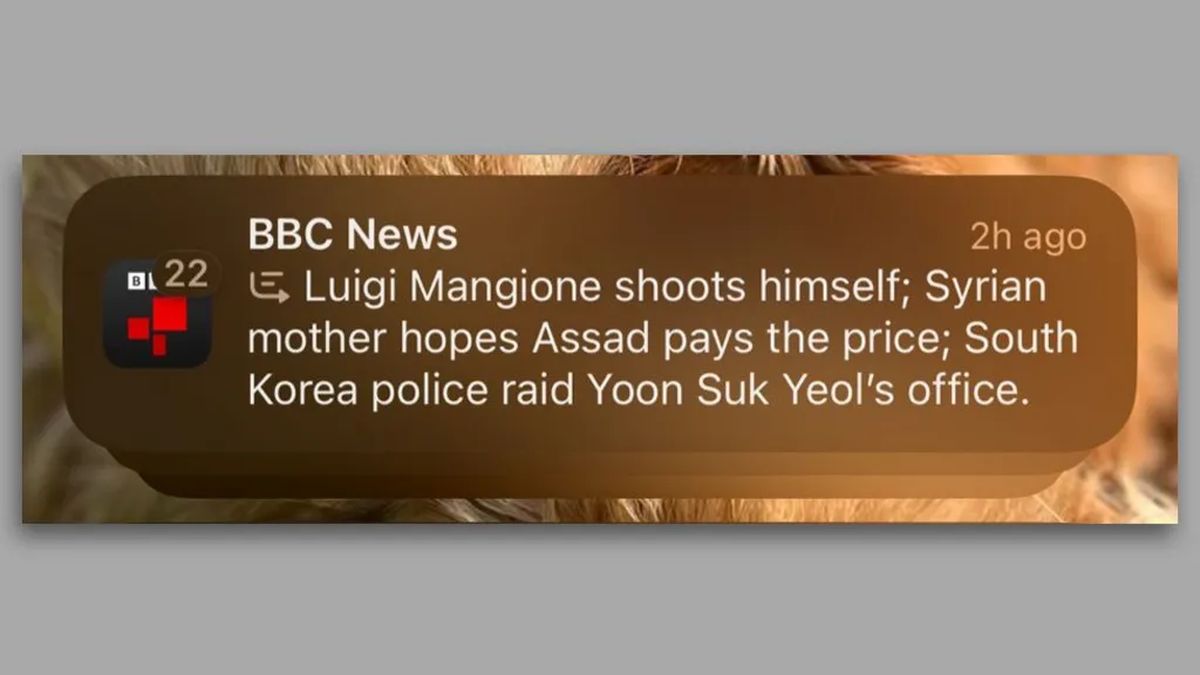

在 2024 年 12 月 13 日的通知中,iPhone 用户收到一条消息,称“Luigi Mangione 开枪自杀”,以及另外两条突发新闻摘要。这个错误的通知很快引起了人们的关注,特别是因为它误报了有关 Mangione 的一个关键细节,Mangione 被指控于 12 月 4 日杀害了联合医疗保健公司前首席执行官布莱恩·汤普森 (Brian Thompson)。 英国广播公司该公司尚未发布任何有关 Mangione 涉嫌开枪自杀的信息,因此向苹果公司提出了投诉。此后,该网络呼吁苹果重新考虑其生成式人工智能工具。

根本问题似乎源于 Apple Intelligence 使用的语言模型 (LLM)。根据 街道”,Orion AI Solutions 总监 Komninos Chatzipapas,“像 GPT-4o 这样的法学硕士……对于什么是真的、什么是假的并没有任何内在的理解。”这些模型根据大量数据集统计预测下一个单词,但这种方法可能会产生听起来可靠但歪曲事实的内容。在这种情况下,查齐帕帕斯推测苹果公司可能无意中用类似的个人开枪自杀的例子来训练其摘要模型,从而产生了误导性的标题。

这一事件的影响超出了苹果公司的内部做法。无国界记者组织敦促该公司取消摘要功能,并强调传播与知名媒体相关的不准确信息的严重性。无国界记者组织的文森特·贝尔蒂尔 铰接式 人们担心人工智能生成的错误信息会损害新闻来源的可信度。他表示,“人工智能是概率机器,事实不能通过掷骰子来决定。”这强化了这样的论点:人工智能模型目前缺乏确保可靠新闻传播所需的成熟度。

这一事件并非孤立事件。自 6 月在美国推出 Apple Intelligence 以来,用户报告了更多不准确信息,其中包括一条错误地称以色列总理本杰明·内塔尼亚胡已被捕的通知。尽管国际刑事法院对内塔尼亚胡发出了逮捕令,但通知省略了关键的背景内容,只显示了“内塔尼亚胡被捕”的字样。

围绕苹果智能的争议揭示了人工智能时代新闻出版商自主权面临的挑战。虽然一些媒体组织积极利用人工智能工具进行写作和报道,但苹果功能的用户收到的摘要可能会歪曲事实,而且这些摘要都以出版商的名义出现。这一原则可能对数字时代信息的报告和感知方式产生更广泛的影响。

苹果尚未回应有关其审查流程或打算采取的任何相关措施的询问。 英国广播公司的 的担忧。 ChatGPT 等平台的引入极大地塑造了当前人工智能技术的格局,刺激了快速创新,但也为可能误导公众的不准确性创造了沃土。随着对人工智能生成的内容及其影响的调查不断进行,确保可靠性和准确性的重要性变得越来越重要。

特色图片来源: 马克西姆·霍普曼/Unsplash