文本到视频生成 甚至已经不是几年前的样子了。我们将其转变为具有真正未来功能的工具。用户为个人页面创建内容,影响者利用它进行自我推销,公司将其用于从广告和教育材料到虚拟培训和电影制作的各种用途。大多数文本到视频系统都是基于扩散变压器的架构构建的,这是视频生成领域的前沿技术。这项技术是 Luma 和 Kling 等服务的基础。然而,这一地位直到 2024 年才得到巩固,当时第一批视频扩散变压器获得了市场采用。

转折点来了 OpenAI 的发布 的 索拉,展示了与现实生活几乎没有区别的极其逼真的镜头。 OpenAI 表明他们的扩散变压器可以成功生成视频内容。这一举措验证了该技术的潜力,并引发了整个行业的趋势:现在,大约 90% 的当前模型都基于扩散变压器。

扩散是一个令人着迷的过程,值得更彻底的探索。让我们了解扩散的工作原理、变压器技术在此过程中解决的挑战,以及为什么它在文本到视频生成中发挥如此重要的作用。

扩散过程是怎样的 基因人工智能?

文本到视频和文本到图像生成的核心在于扩散过程。受到物质逐渐混合的物理现象的启发(就像墨水在水中扩散一样),机器学习中的扩散模型涉及两个步骤的过程:向数据添加噪声,然后学习将其消除。

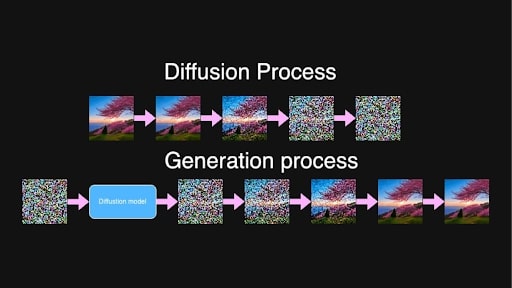

在训练过程中,模型会获取图像或视频帧序列,并通过几个步骤逐步添加噪声,直到原始内容变得无法区分。本质上,它把它变成了纯粹的噪音。

“日出时山上美丽的吹樱花树”提示的扩散和生成过程

“日出时山上美丽的吹樱花树”提示的扩散和生成过程

当生成新内容时,该过程相反。该模型经过训练可以增量预测和消除噪声,重点关注两点 t 和 t+1 之间的随机中间噪声步骤。由于训练过程较长,该模型观察了从纯噪声到几乎干净的图像的所有步骤,现在基本上具有识别和减少任何级别的噪声的能力。

该模型根据随机的纯噪声,在输入文本的引导下,迭代地创建连贯且与文本描述匹配的视频帧。高质量、详细的视频内容是这个渐进过程的结果。

潜在扩散使得这在计算上成为可能。数据不是直接处理高分辨率图像或视频,而是由编码器压缩到潜在空间中。

这样做是为了(显着)减少模型需要处理的数据量,从而在不影响质量的情况下加速生成。在扩散过程细化潜在表示后,解码器将它们转换回全分辨率图像或视频。

视频生成的问题

与单个图像不同,视频要求对象和角色始终保持稳定,以防止出现意外的外观变化或变化。我们都已经看到了生成人工智能的奇迹,但偶尔缺失手臂或难以区分的面部表情完全属于正常现象。然而,在视频中,风险更大。一致性对于流畅的感觉至关重要。

因此,如果角色出现在第一帧中穿着特定的服装,则该服装在后续的每个帧中看起来都必须相同。角色外观的任何变化,或者背景中物体的任何“变形”,都会破坏连续性,使视频感觉不自然甚至怪异。

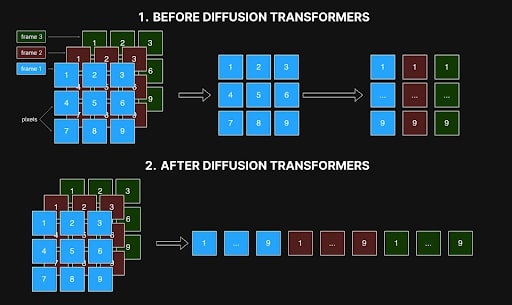

图片由作者提供

早期的方法通过单独处理帧来生成视频,一帧中的每个像素仅引用其他帧中对应的像素。然而,这种逐帧方法通常会导致不一致,因为它无法捕获帧之间的空间和时间关系,而这对于平滑过渡和真实运动至关重要。颜色变化、形状波动或特征错位等伪像都是缺乏连贯性的结果,并降低了视频的整体质量。

图片由作者提供

图片由作者提供

解决这个问题的最大障碍是计算需求和成本。对于每秒 10 帧的 10 秒视频,生成 100 帧会呈指数级增加复杂性。由于需要精确的帧间一致性,创建这 100 个帧比生成单个帧复杂大约 10,000 倍。此任务需要 10,000 倍以上的内存、处理时间和计算资源,通常超出实际限制。正如您可以想象的那样,业内少数人可以尝试这一过程。

这就是 OpenAI 发布 SORA 如此重要的原因:他们证明了扩散变压器确实可以处理视频生成,尽管任务非常复杂。

扩散变压器如何解决视频生成中的自一致性问题

扩散变压器的出现解决了几个问题:它们能够生成任意分辨率和长度的视频,同时实现高度的自一致性。这主要是因为它们可以处理长序列,只要它们适合记忆,并且由于自注意力机制。

在人工智能中,自注意力是一种计算序列中元素之间的注意力权重的机制,确定每个元素应该受到其他元素的影响程度。它使序列中的每个元素能够同时考虑所有其他元素,并允许模型在生成输出时专注于输入数据的相关部分,捕获跨空间和时间的依赖关系。

在视频生成中,这意味着每个帧中的每个像素都可以与所有帧中的每个其他像素相关。这种相互关联性确保了整个视频中的对象和角色从头到尾保持一致。如果一个角色出现在一帧中,自注意力有助于防止变化并在所有后续帧中保持该角色的外观。

之前,模型在卷积网络中引入了一种自注意力形式,但这种结构限制了它们实现与扩散变压器现在相同的一致性和连贯性的能力。

然而,通过扩散变压器中的同时时空注意力,该架构可以同时加载来自不同帧的数据并将它们作为统一的序列进行分析。如下图所示,以前的方法处理每个帧内的交互,仅将每个像素与其在其他帧中的相应位置相关联(见图 1)。这种受限的视野阻碍了他们捕捉平滑和真实运动所必需的空间和时间关系的能力。现在,借助扩散变压器,一切都可以同时处理(图 2)。

变压器前后扩散网络的时空相互作用。图片由作者提供

变压器前后扩散网络的时空相互作用。图片由作者提供

这种整体处理可以保持跨帧的稳定细节,确保场景不会意外变形并变成最终产品的不连贯混乱。扩散变压器还可以处理任意长度和分辨率的序列,只要它们适合内存即可。通过这一进步,可以在不牺牲一致性或质量的情况下生成更长的视频,解决了以前基于卷积的方法无法克服的挑战。

扩散变压器的到来重塑了文本到视频的生成。它可以制作任意长度和分辨率的高质量、一致的视频。变压器中的自注意力是解决维护框架一致性和处理复杂的空间和时间关系等挑战的关键组成部分。 OpenAI 发布的 SORA 证明了这一能力,在行业中树立了新标准:现在,大约 90% 的先进文本到视频系统都基于扩散变压器,其中 Luma、Clink 和 Runway Gen-3 等主要厂商处于领先地位。市场。

尽管取得了这些惊人的进步,扩散变换器仍然非常耗费资源,比单图像生成需要的资源多近 10,000 倍,使得训练高质量模型仍然是一项非常昂贵的任务。尽管如此,开源社区已经采取了重大措施来使这项技术更容易使用。 Open-SORA 和 Open-SORA-Plan 等项目以及 Mira Video Generation、Cog 和 Cog-2 等其他举措为开发人员和研究人员的实验和创新开辟了新的可能性。在公司和学术机构的支持下,这些开源项目为视频生成的持续进步和更大的可访问性带来了希望,不仅使大公司受益,也使热衷于实验的独立创作者和爱好者受益。与任何其他社区驱动的努力一样,这开辟了视频生成民主化的未来,将这项强大的技术带给更多的创意人员来探索。