OpenAI 可能很快就会发布一款能够控制用户 PC 并代表他们执行操作的 AI 工具,称为 Operator 工具。软件工程师 Tibor Blaho 以准确泄露即将推出的人工智能产品而闻名, 索赔 找到支持这一发展的证据。

OpenAI 计划一月份推出人工智能工具 Operator

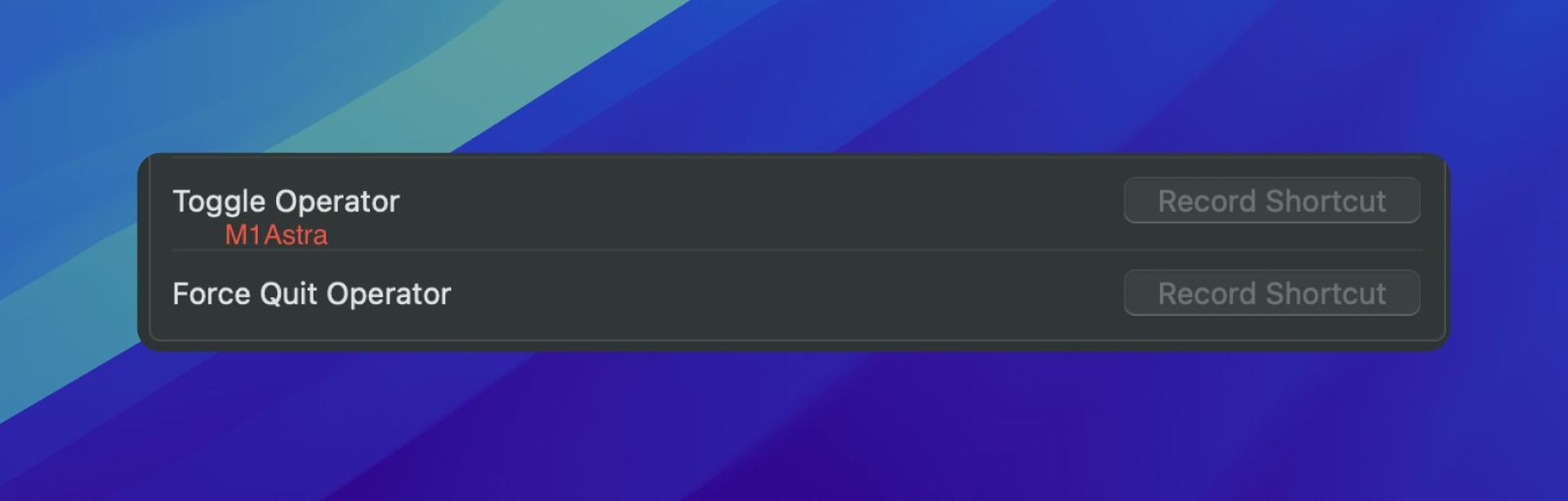

据报道,OpenAI 的目标是 一月推出 Operator。 Blaho 最近的发现包括 OpenAI 的 ChatGPT macOS 客户端中的隐藏选项,允许用户定义“切换操作符”和“强制退出操作符”的快捷方式。此外,Blaho 指出,OpenAI 在其网站上添加了对 Operator 的引用,尽管这些引用尚未公开可见。

OpenAI 将于 1 月推出自主人工智能代理 Operator

Blaho 表示,该网站还包含未发布的表格,比较 Operator 与其他使用计算机的人工智能系统的性能。如果数字准确,则表明 Operator 并不完全可靠,具体取决于任务。例如,在模拟真实计算机环境的 OSWorld 基准测试中,“OpenAI 计算机使用代理(CUA)”得分为 38.1%,优于 Anthropic 的模型,但明显低于人类的 72.4% 得分。 OpenAI CUA 在评估 AI 网络导航技能的 WebVoyager 测试中确实优于人类代理,但在另一个基准测试 WebArena 上表现不佳。

操作员似乎很难完成对人类来说通常很容易完成的任务。在要求 Operator 注册云提供商并启动虚拟机的测试中,它的成功率为 60%。与此同时,根据泄露的信息,它仅在 10% 的时间内成功创建了比特币钱包 基准。

OpenAI 进入人工智能代理领域之际,Anthropic 和谷歌等竞争对手也在这一领域取得进展。分析公司 Markets and Markets 预计,到 2030 年,人工智能代理的市场可能达到 471 亿美元。虽然人工智能代理仍处于发展的初级阶段,但一些专家对其安全性表示担忧,尤其是在技术迅速进步的情况下。

一张泄露的图表表明,Operator 在某些安全评估中表现良好,特别是在抵制从事非法活动和搜索敏感个人数据的企图方面。据了解,安全测试导致了Operator的开发周期过长。 OpenAI 联合创始人 Wojciech Zaremba 批评的 Anthropic 最近因缺乏安全措施而发布了代理,这表明如果 OpenAI 加速发布类似的代理,可能会遭到强烈反对。

人工智能研究人员和前员工对 OpenAI 提出了批评,称其将技术的快速产品化置于安全措施之上。

图片来源:Tibor Blaho