Microsoft Corp.拥有 扩展 其开源语言模型的PHI系列通过引入了两种专为多模式处理和硬件效率设计的新算法:PHI-4-MINI和PHI-4-MultiModal。

phi-4-mini和phi-4-multimodal特征

Phi-4-Mini是一种仅文本模型,它包含38亿个参数,使其能够在移动设备上有效运行。它基于仅解码器的变压器体系结构,该体系结构仅分析单词之前的文本以确定其含义,从而提高处理速度并降低硬件要求。此外,PHI-4-MINI利用一种称为分组查询注意(GQA)的性能优化技术来减少与其注意力机制相关的硬件使用情况。

Microsoft PHI-4 AI用14B参数处理复杂数学

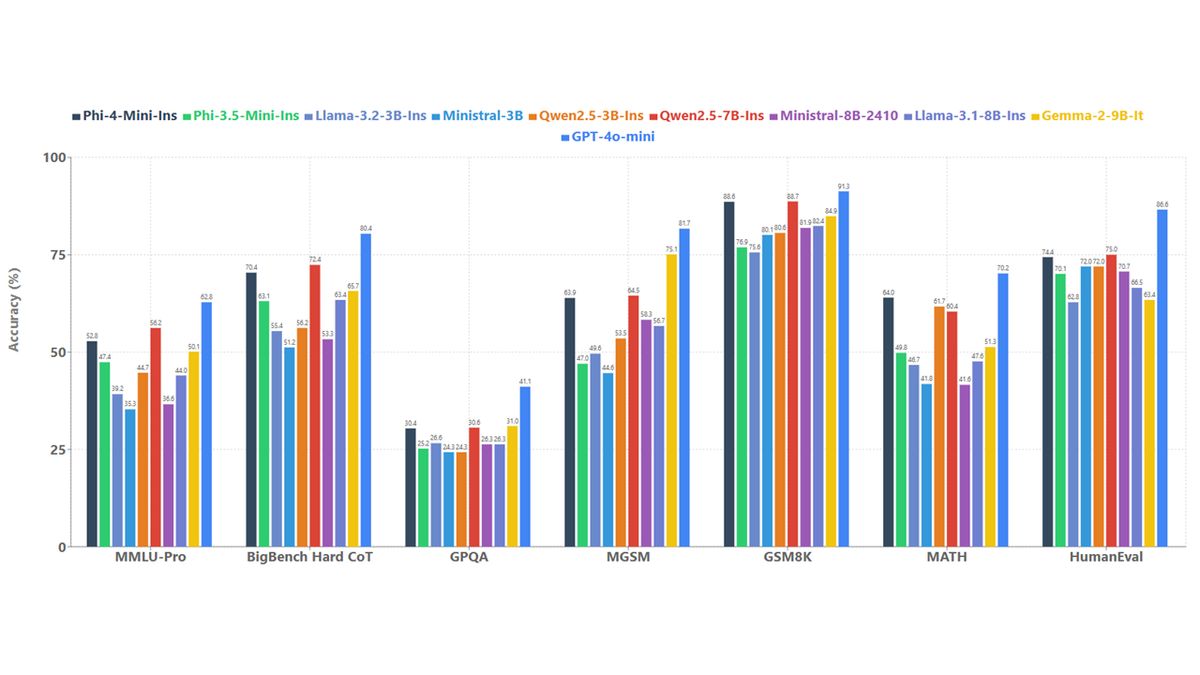

该模型能够在外部应用程序中生成文本,翻译文档和执行操作。 Microsoft声称PHI-4-MINI在需要复杂推理(例如数学计算和编码挑战)的任务中表现出色,与其他类似尺寸的语言模型相比,内部基准测试的准确性显着提高了精度。

第二种模型Phi-4-MultiModal是Phi-4-Mini的增强版本,具有56亿个参数。它能够处理文本,图像,音频和视频输入。该模型是使用一种称为Loras混合物的新技术训练的,该技术优化了该模型的多模式处理能力,而没有对其现有权重进行大量修改。

微软对PHI-4-MultiModal进行了基准测试,在该测试中,它在视觉数据处理中的平均得分为72,距离OpenAI的GPT-4少得分,该GPT-4的得分为73。Google的Google的Gemini Flash 2.0,得分为74.3。在合并的视觉和音频任务中,Phi-4-Multimodal的表现优于Gemini-2.0闪光灯“大幅度”,并且超过了Interomni,该闪光是专门用于多模式处理的。

Phi-4-Multimodal和Phi-4-Mini均获得MIT许可证的许可,并将通过 拥抱脸,允许商业用途。开发人员可以通过 Azure AI铸造厂 和 NVIDIA API目录 进一步探索他们的潜力。

PHI-4-MultiModal的设计旨在通过将多种输入类型整合到单个处理模型中来促进自然和上下文感知的相互作用。它包括更大的词汇,多语言功能等增强功能,以及提高的计算效率以实现设备执行。

Phi-4-Mini在基于文本的任务(包括推理和功能称呼功能)中提供了令人印象深刻的性能,从而使其能够有效地与结构化编程接口进行交互。该平台支持多达128,000个令牌的序列。

此外,这两种模型都经过了广泛的安全性和安全性测试,由微软内部Azure AI红色团队(AIRT)领导,该模型使用全面的评估方法来评估模型,这些方法解决了当前的网络安全,公平性和用户安全性的趋势。

自定义和易于部署是这些模型的其他优点,因为它们的较小尺寸允许它们对具有相对较低计算需求的特定任务进行微调。适合微调的任务示例包括语音翻译和医学问答。

有关模型及其应用的更多详细信息,鼓励开发人员参考 PHI食谱 在Github上可用。

特色图片来源:Microsoft